La guerra de Irán ha convertido en visible algo que hasta ahora avanzaba de forma más discreta: la entrada de la inteligencia artificial en el núcleo de la toma de decisiones militares de Estados Unidos. El almirante Brad Cooper, jefe del mando estadounidense en el conflicto, confirmó el uso de “una variedad de herramientas avanzadas de IA” para procesar grandes volúmenes de información y permitir decisiones “más inteligentes” en plazos que pasan de horas o días a segundos. Esa admisión encaja con la estrategia oficial del Departamento de Defensa, que desde enero de 2026 define la IA como un factor llamado a redefinir la guerra en la próxima década.

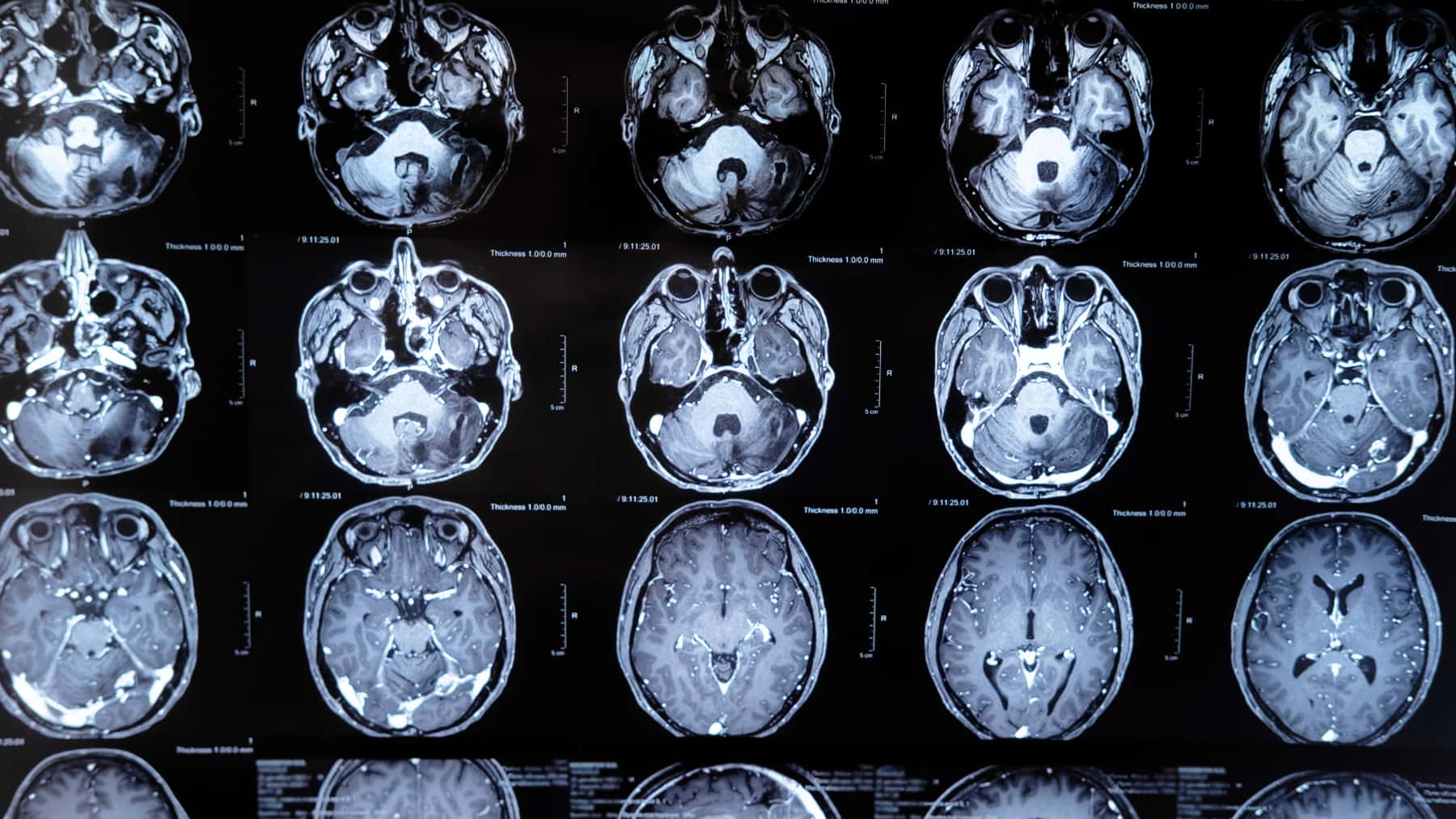

El problema es que esa aceleración no equivale automáticamente a mayor fiabilidad. Chatham House advierte de que el conflicto ha amplificado los riesgos del uso de IA para apoyar la selección de objetivos, especialmente cuando los sistemas trabajan con datos incompletos, desactualizados o distintos de aquellos con los que fueron entrenados. En ese escenario, una herramienta útil para clasificar señales y priorizar amenazas puede también introducir errores difíciles de detectar cuando la presión operativa empuja a actuar deprisa.

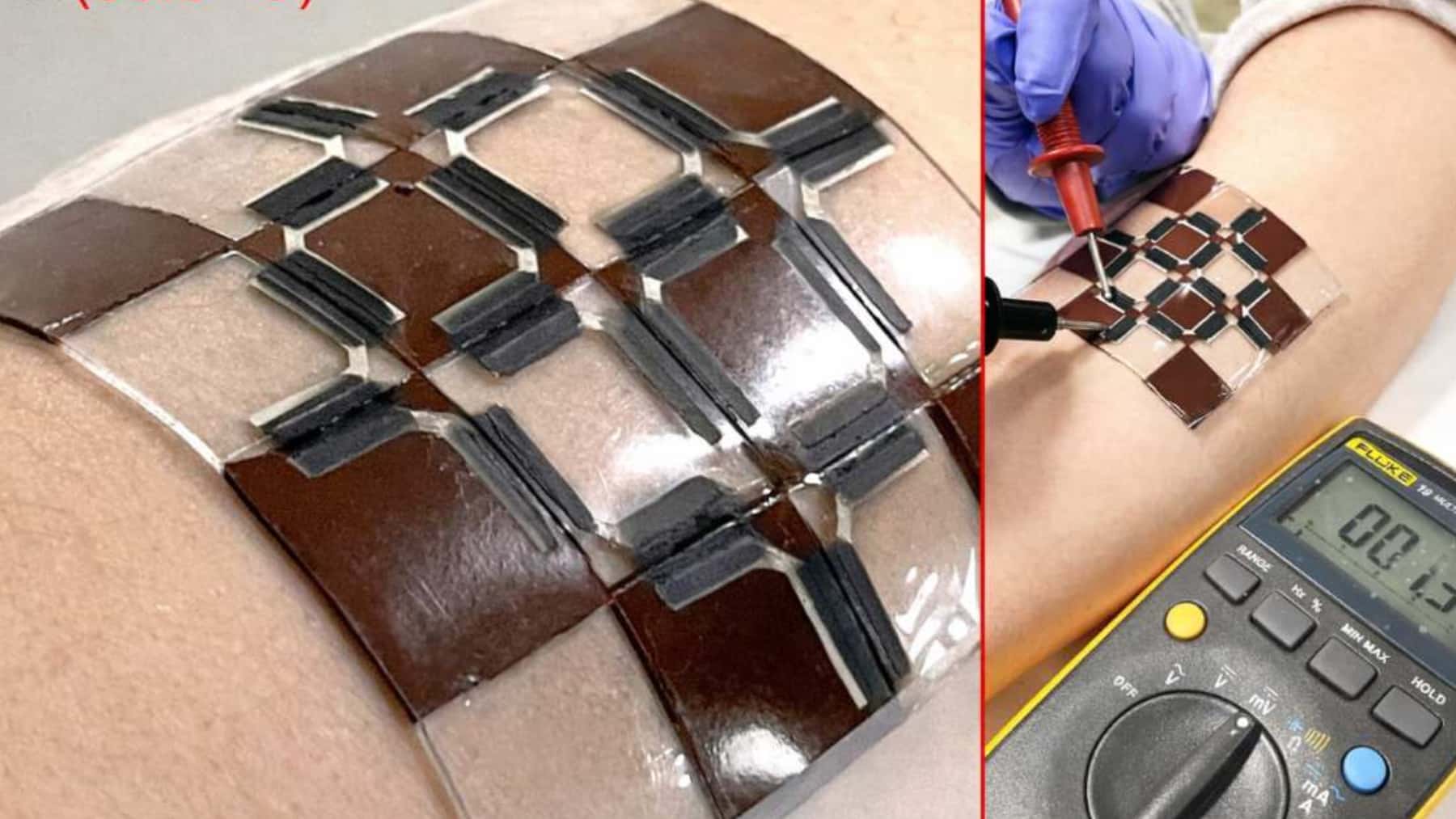

La infraestructura técnica de ese cambio no surgió con Irán. El programa Maven, creado por el Pentágono en 2017, ya buscaba integrar algoritmos en operaciones militares para analizar imágenes, identificar objetos y acelerar la explotación de inteligencia. Desde entonces, la adopción se ha extendido. La OTAN adquirió en 2025 una versión del Maven Smart System para reforzar la explotación de datos complejos y acortar tiempos de decisión, una señal de que estas herramientas han dejado de ser experimentales para convertirse en parte de la arquitectura militar aliada.

La propia guerra de Irán ha ofrecido el ejemplo más visible de esa transición. Chatham House señala que Washington estaría utilizando una versión propia de Maven para apoyar información de objetivos en las operaciones, aunque sigue sin estar claro con qué grado exacto de automatización o dependencia real. Esa opacidad es central, porque la diferencia entre una IA que asiste a un analista y otra que estrecha el tiempo disponible para cuestionar una recomendación no es técnica, sino política y jurídica.

La discusión se endureció tras el bombardeo del 28 de febrero sobre una escuela de niñas en Minab, que, según una carta de senadores demócratas y un análisis citado por Chatham House, figuraba en una lista de objetivos estadounidense. No existe confirmación pública de que la IA interviniera en la selección concreta de ese blanco, pero el episodio ha colocado el foco sobre el verdadero riesgo: sistemas que aceleran procesos en contextos donde un dato erróneo o una supervisión insuficiente pueden traducirse en víctimas civiles.

En paralelo, la guerra también ha mostrado otra capa del problema. Associated Press documenta que Irán y sus aliados digitales han integrado ciberataques, spyware y desinformación amplificada por IA en sus operaciones, mientras autoridades estadounidenses reconocen que estas tecnologías influirán cada vez más tanto en la ofensiva como en la defensa. La IA, por tanto, no aparece aquí como un arma aislada, sino como una capa transversal de toda la guerra.